大模型本地部署以及可视化方案

基于 Ollama + DeepSeek + CherryStudio | RAGFlow 的本地化大模型部署体系,提供从模型加载、推理优化到可视化交互的全栈解决方案。CherryStudio

提供可视化界面,支持对话记录管理、模型性能监控及 Prompt 调试;RAGFlow 则打通知识库与工作流,实现检索增强生成的全流程自动化。

本地知识库和大模型检索增强(RAG)方案

通过 向量数据库 + 多模态大模型 深度协同,构建动态知识增强体系。基于文本、表格、图像的向量化检索技术,实时匹配知识库中的专业内容。

大模型交互提示词优化方案

采用 结构化模板 + 动态上下文管理 的复合策略,解决大模型指令对齐难题。预设法律咨询、代码生成等场景的标准化 Prompt 框架,通过占位符变量注入用户参数,提升意图识别准确率。

分布式微服务架构方案

基于 Spring Cloud 框架 构建跨平台异构系统,采用模块化微服务设计,将模型推理、知识检索、业务逻辑等能力解耦为独立服务单元。方案兼容 Kubernetes 与 Docker

生态,实现资源弹性伸缩与灰度发布。

Java 生态圈 AI 对接方案

依托 Spring AI 框架打造企业级 AI 中台,提供从大模型接入、流量管控到数据安全的完整解决方案。通过标准化 API 抽象层,统一管理 GPT、DeepSeek 等异构模型,深度集成

Spring Security 与审计模块,确保模型调用链中的合规流转。

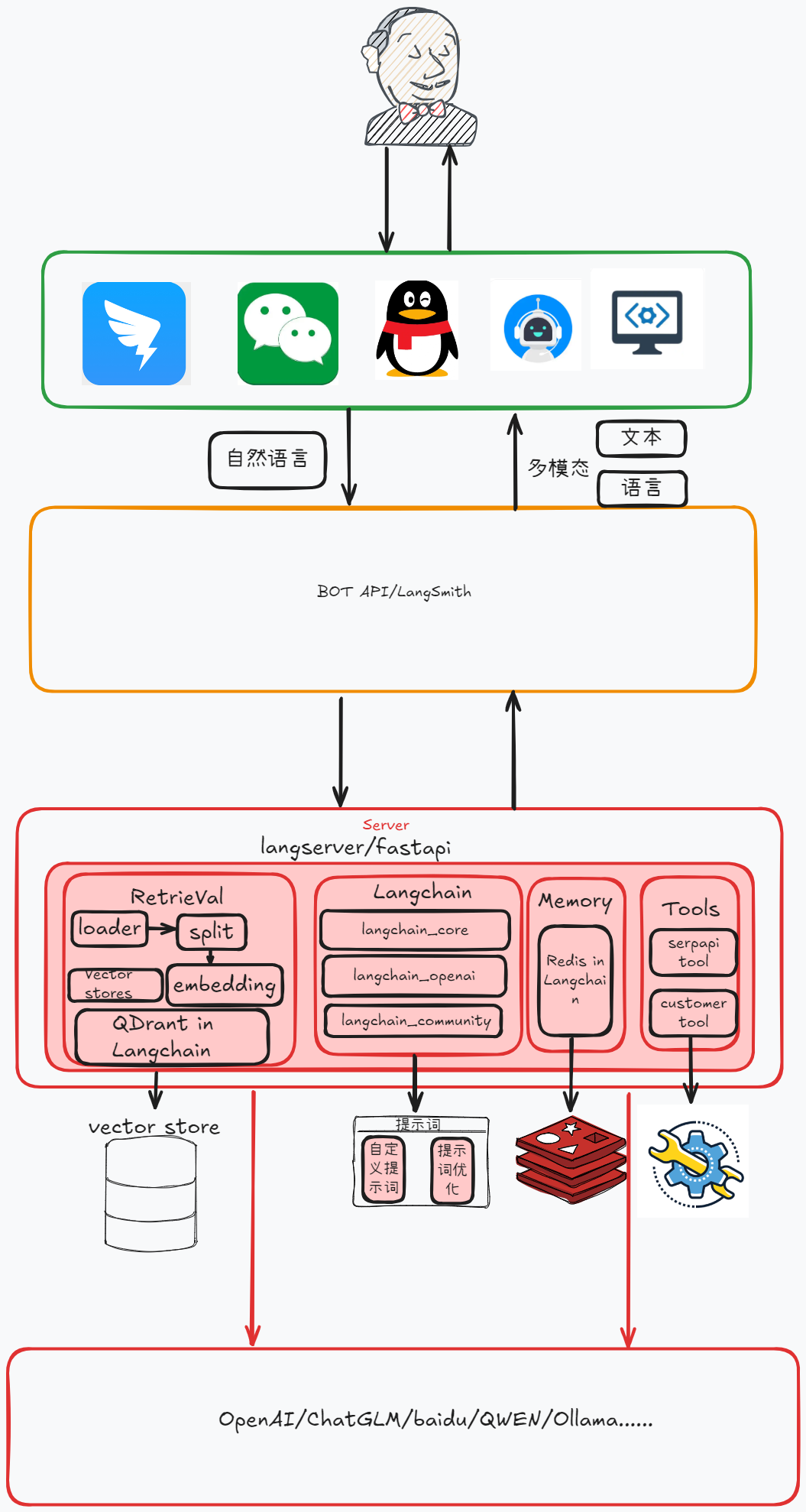

Python 生态圈 AI 对接方案

基于 LangChain 构建智能体编排引擎,实现工具调用、记忆管理、多模型协作的自动化流水线。通过 Chain 组件快速组装 RAG 检索、SQL 生成、代码解释等原子能力。

高效的语义搜索与多模态数据处理方案

采用 Pinecone 全托管向量数据库 构建亿级数据实时检索体系,支持文本、图像、音视频的跨模态语义匹配。通过混合检索算法(关键词 +

向量)平衡精度与召回率,满足电商推荐、版权查重等场景需求。

点击查看

点击查看